El desafío de la fragmentación masiva de datos

El 80% de los datos que tiene una organización no son de misión crítica, sino datos secundarios. Una información que sigue creciendo en esta era eminentemente digital y cuyo almacenamiento es preciso mejorar, pues ahora se caracteriza por su dispersión en silos y baja eficiencia.

Nadie pone en duda de que en esta era eminentemente digital los datos son uno de los activos más valiosos en las organizaciones. Paradójicamente, al mismo tiempo, constituyen uno de los mayores obstáculos en el proceso de transformación digital. La razón reside en la llamada fragmentación masiva de datos, un concepto más conocido por su acepción inglesa ‘Mass Data Fragmentation’ (MDF) y que se refiere a la existencia de ingentes cantidades de datos que se ubican en diferentes ubicaciones, silos de infraestructura y sistemas de gestión, una realidad que impide que las organizaciones extraigan valor de éstos.

Esta fragmentación masiva de datos es especialmente acuciante en el llamado almacenamiento secundario o, lo que es lo mismo, en los sistemas que se encargan de guardar aquellos datos que no son de misión crítica. Se trata de datos que no son de rabioso negocio como sí lo son los que se encuentran en las bases de datos, el CRM, etc. y, por tanto, no requieren de una respuesta inmediata, pero que conforman el grueso del almacenamiento en las organizaciones.

De hecho, se estima que el 80% de los datos que tiene una organización no son de misión crítica, sino datos secundarios estáticos que se almacenan en copias de seguridad (backups), archivos, documentos compartidos, almacenes de objetos, sistemas de pruebas y desarrollo, analítica, conjuntos de datos, nubes privadas y públicas… Estos datos, tal y como apuntan los analistas del mercado, no paran de crecer; solo tenemos que mirar las tendencias que vienen, como es el auge del Internet de las cosas y la sensorización, para adivinar la avalancha de datos secundarios a la que se deberán enfrentar las organizaciones.

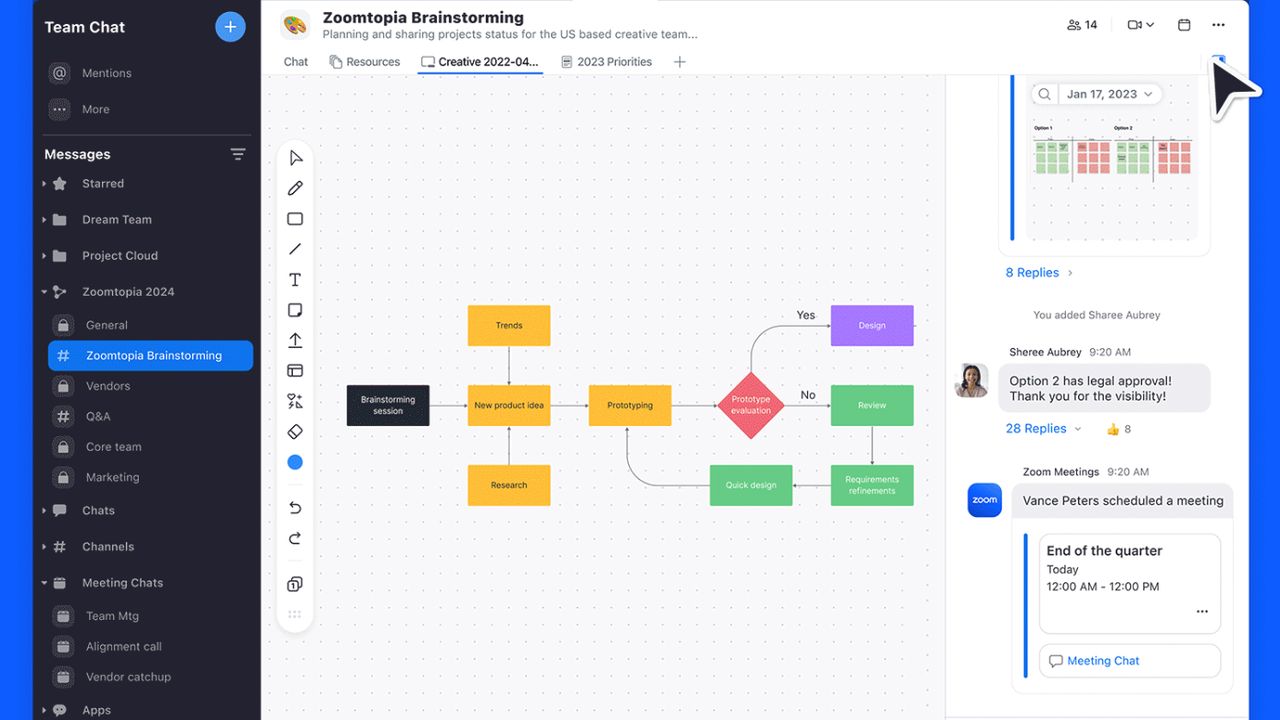

La explosión que se está produciendo en volúmenes de datos, junto a la falta de innovación por parte de los proveedores del ámbito de almacenamiento secundario (cuyo enfoque está obsoleto sin haber avanzado apenas en 20 años) han hecho casi imposible que las organizaciones puedan proteger, localizar, gestionar o explotar su activo digital más importante. La fragmentación masiva de datos se ha convertido, por tanto, en un auténtico quebradero de cabeza para los equipos de TI, como lo atestigua el informe Secondary Data Market Study realizado por Vanson Bourne para Cohesity, compañía que nació en 2013 con el objetivo de dar una solución definitiva a la protección, almacenamiento, gestión y extracción de información de los datos secundarios a través de una única plataforma.

Puede leer el artículo completo aquí