La transparencia y ética en el uso de la información otorgan confianza y valor añadido a los ciudadanos

La era digital en la que estamos inmersos provoca que para ser competitivos debamos aprender a gestionar y explotar uno de nuestros activos intangibles más valiosos, los datos. Difícilmente conocemos y entendemos todos los datos a los que tenemos acceso, y menos aún las maneras en que podemos utilizarlos.

La era digital en la que estamos inmersos provoca que para ser competitivos debamos aprender a gestionar y explotar uno de nuestros activos intangibles más valiosos, los datos. Ciertamente ahora hay infinidad de oportunidades para la generación de nuevos productos y servicios, pero existe un número muy elevado de riesgos inherentes al tsunami de los datos. Difícilmente conocemos y entendemos todos los datos a los que tenemos acceso, y menos aún las maneras en que podemos utilizarlos.

Organizaciones de todo tipo y tamaño recolectan, almacenan, procesan e intercambian grandes volúmenes de información con el deseo de crear nuevos productos y servicios a partir de los datos que generen mayores beneficios, reduzcan los costes, consoliden y refuercen la fidelidad de los clientes, y ofrezcan auténticas ventajas competitivas. Pero al mismo tiempo, se enfrentan a importantes retos tales como gestionar adecuadamente los datos, garantizar su privacidad, o cumplir con regulaciones y estándares internos y externos.

En el ámbito regulatorio es obvio que son necesarias nuevas reglas de juego. En este contexto, en enero de 2012 la Comisión Europea presentó una reforma integral de las normas de protección de datos con el objetivo principal de incrementar el control de los ciudadanos sobre sus datos. Esta reforma se materializó en el Reglamento General de Protección de Datos (GDPR por sus siglas en inglés).

GDPR establece las reglas de actuación para cualquier empresa privada y entidad púbica que gestione, almacene o procese datos personales de ciudadanos de la Unión Europea. El Reglamento nos lleva a la necesidad de revisar nuestra organización, procesos y tecnologías con las que gestionamos datos personales, y por tanto de algunos de nuestros modelos de negocio.

La transparencia en el uso de los datos personales es ahora un requerimiento legal, pero por otra parte constituye la oportunidad perfecta para la creación de confianza con nuestros clientes, y por tanto de valor añadido.

Ética en el uso y explotación de los datos

En el marco de GDPR las organizaciones se encuentran con un elevado número de requerimientos para poder utilizar, dentro de la legalidad, los datos personales de los ciudadanos de la Unión Europea pero además existe un creciente interés por contemplar los aspectos éticos derivados del uso y explotación de los datos de las personas.

Definida de manera simple, la ética son los principios de comportamiento basados en ideas de lo correcto y lo incorrecto. Estos se basan en conceptos tales como la equidad, el respeto, la responsabilidad, la integridad, la calidad, la confiabilidad, la transparencia y la confianza.

La ética en el tratamiento de los datos tiene que ver con la forma en la que obtenemos, almacenamos, administramos, usamos y disponemos de los datos de manera que estén alineados con estos principios. Gestionar los datos de manera ética es necesario para el éxito a largo plazo de cualquier organización, en última instancia, para los profesionales de la gestión de datos y las organizaciones para las que trabajan, la ética de datos es una cuestión de responsabilidad social.

Especialmente debemos ser sensibles a los tipos de análisis realizados y a los resultados obtenidos de los mismos. La aparición de algoritmos de inteligencia artificial (en adelante IA) como “gaydar”, mediante el cual los investigadores aseguran poder identificar personas homosexuales utilizando un sistema de reconocimiento facial, debe ponernos en alerta ante los peligros de la clasificación dicotómica de la persona, y adicionalmente del uso que se puede dar a dicha clasificación.

Obviamente basándose únicamente en una fotografía la inteligencia artificial no puede determinar si alguien es homosexual. Pero esta investigación aflora alguno de los temores más comunes sobre la IA: que abrirá nuevas maneras de vigilancia y de control, y que podría ser especialmente perjudicial para las personas marginadas y en riesgo de exclusión social. Uno de los autores de este trabajo, el Dr. Michael Kosinski, dice que su intención es alertar sobre los peligros de la IA y advierte que el reconocimiento facial pronto podrá identificar no solo la orientación sexual de alguien, sino sus opiniones políticas, criminalidad e incluso su coeficiente de inteligencia.

Con afirmaciones de este tipo resulta preocupante que estemos reviviendo una vieja creencia con un trasfondo histórico terrible: poder intuir características de las personas a partir de la apariencia. Mientras que los críticos del trabajo acusan de reemplazar herramientas antiguas con las redes neuronales del siglo XXI, el Dr. Kosinski dice estar horrorizado de sus propios hallazgos y feliz de haber demostrado que estaba equivocado.

Recientemente DeepMind, compañía propiedad de Google desde 2014, ha creado un equipo llamado DeepMind Ethics & Society (o DMES) para investigar los problemas más espinosos de la inteligencia artificial y el impacto de la inteligencia artificial en la sociedad. Su actividad incluye aspectos como el análisis de cómo gestionar los problemas derivados del sesgo provocado por la IA, el impacto económico que tiene la automatización, o la necesidad de garantizar que cualquier sistema inteligente que desarrollemos comparta nuestros valores éticos y morales.

Quizá a algunos les sorprenda, por el carácter altruista de la iniciativa, no obstante es importante destacar DeepMind ha tenido problemas en el pasado en un proyecto de análisis de datos del National Health Service (NHS) de Reino Unido, el proyecto en cuestión que procesaba datos médicos de 1,6 millones de pacientes, fue declarado ilegal por la autoridad de protección de datos de UK.

DMES publicará sus investigaciones a partir de principios de 2018 y colabora con otros grupos académicos que realizan investigaciones similares, incluido el AI Now Institute de la New York University, o el Leverhulme Centre for the Future of Intelligence de Reino Unido.

En una publicación de su blog explicando el porqué de la creación del equipo, los codirectores Verity Harding y Sean Legassick indican que DMES ayudará a "explorar y comprender los impactos de la inteligencia artificial en el mundo real". Para ejemplos de cómo funciona este trabajo, mencionan investigaciones sobre el racismo en algoritmos de justicia penal, y discusiones sobre temas como la ética en accidentes de tráfico provocados por automóviles sin conductor. "Si las tecnologías de la IA existen para servir a la sociedad, deben estar modeladas por las prioridades y preocupaciones de la sociedad", escriben Harding y Legassick.

Este tema no es nuevo, para los interesados recomiendo la lectura de “Weapons of Math Destruction” de Cathy O’Neil. Este libro está escrito desde la perspectiva de un profesional que tras trabajar en el ámbito descubre las desigualdades y discriminación creados a partir de los algoritmos. De hecho, un aspecto interesante es que se transforma en un activista que intenta resolver algunas de estas desigualdades.

Tal como describe la autora, vivimos en la era de los algoritmos. Cada vez más, las decisiones que afectan nuestras vidas, a dónde vamos a la escuela, si obtenemos un préstamo, cuánto pagamos por el seguro, no están hechas por humanos, sino por modelos matemáticos. En teoría, esto debería conducir a una mayor equidad: todos son juzgados de acuerdo con las mismas reglas, y se elimina el sesgo.

Y sin embargo, como revela Cathy O'Neil, en este libro los modelos que se utilizan hoy son opacos, no regulados e incontestables, incluso cuando están equivocados. Lo más preocupante es que refuerzan la discriminación. Al rastrear el arco de la vida de una persona, O'Neil expone los modelos de caja negra que dan forma a nuestro futuro, como individuos y como sociedad. Estas "armas de destrucción matemática" califican a maestros y estudiantes, clasifican CV, conceden o niegan préstamos, evalúan a los trabajadores, se dirigen a los votantes y monitorizan nuestra salud.

O'Neil hace un llamamiento a modeladores y programadores para que asuman más responsabilidad sobre sus algoritmos, y a los responsables de la definición de políticas a fin de regular su uso.

Uno de los problemas al que se enfrentan los profesionales dedicados a la gestión y explotación de los datos (sin entrar en las múltiples categorías existentes) es que aquellos análisis de datos que aplican o crean (y que sin duda pueden llegar a ser muy beneficiosos para una organización) a veces no lo son tanto para las personas. No se trata entonces tan solo de conocer la regulación, las técnicas, las mejores prácticas, el uso de técnicas de privacidad de datos, … sino también qué valores éticos debe tener nuestra organización. Y que en la fórmula del valor para cliente se tengan en cuenta estos puntos.

En una época como la que estamos viviendo, la revisión de los valores éticos se vuelve absolutamente necesaria. De este modo, se trata de erradicar desde el principio cualquier atisbo de comportamiento inmoral, como ocurrió en marzo de 2016 con Tay, un chatbot creado por Microsoft para hablar por Twitter con jóvenes de entre 18 y 24 años y que tuvo que ser retirado porque “aprendió” a escribir mensajes racistas.

La pregunta que surge es, además de pedir transparencia a los fabricantes de este tipo de algoritmos en sus desarrollos, ¿qué más es necesario para garantizar el comportamiento ético de la inteligencia artificial. Algunas de las respuestas a esta pregunta son competencia de la Roboética, una disciplina cuyo origen se remonta al cuento “Círculo vicioso”, publicado en 1942 en el libro “Yo, robot”, de Isaac Asimov. Uno de los objetivos de esta rama de la ética es afianzar que el diseño de este tipo de máquinas garantiza la seguridad de todos los humanos.

No sólo es muy necesaria una regulación, sino que además debe existir un esfuerzo de estandarización de los procesos de diseño y evaluación de los sistemas inteligentes autónomos, es decir, de las máquinas capaces de tomar por sí mismas decisiones racionales. En este sentido, ya existen iniciativas en el Parlamento Europeo para estudiar la legislación pertinente que regule el uso apropiado de la inteligencia artificial.

¿Cómo tener en cuenta la ética en nuestros procesos de tratamiento de los datos?

La ética del manejo de datos es compleja, pero se centra en conceptos tales como el impacto que tiene en las personas la calidad de los datos debido a que estos representan características de las personas y se utilizan para tomar decisiones que les afectan; en que el uso indebido de los datos afecta negativamente a las personas y las organizaciones, por lo es imperativo evitarlo; y finalmente en que los datos tienen valor económico per se.

Más allá del cumplimiento de leyes y de regulaciones internas y externas, los profesionales de la gestión y explotación de los datos debemos reconocer que existen razones éticas para proteger la información y garantizar que no se utiliza indebidamente. Incluso los datos que no identifican directamente a las personas se pueden utilizar para tomar decisiones que afectan a su vida.

El imperativo ético para proteger la información se extiende a la gestión de su calidad. Esta responsabilidad alcanza a lo largo y ancho del ciclo de vida de los datos, desde su creación hasta su potencial archivado y destrucción.

Suponer que si únicamente seguimos al pie de la letra la ley no tendremos riesgos asociados es algo erróneo. Las organizaciones usan los datos de maneras que no hubiéramos imaginado en el pasado. Si bien las leyes tienen en cuenta algunos principios éticos, es imposible que la legislación pueda mantenerse al día respecto a los riesgos asociados con la evolución del entorno de datos.

Al igual que las declaraciones de W. Edward Deming sobre la calidad, la ética significa "hacerlo bien cuando nadie está mirando". Un enfoque ético del uso de datos se reconoce cada vez más como una ventaja empresarial competitiva. El manejo de datos éticos aumenta la confianza hacia una organización, sus datos, y los resultados del proceso.

Crear una cultura ética implica introducir una gobernanza adecuada, incluida la institución de controles para garantizar que los resultados previstos y resultantes del procesamiento de datos sean éticos y no violen la confianza ni infrinjan la dignidad humana.

Un programa de gestión y gobierno de los datos es la primera pieza sobre la que sustentar una adecuada explotación de la información, considerando los datos y posterior información inferida a partir de ellos como activos empresariales valiosos. Los datos y la información han de ser gestionados de manera cuidadosa, como cualquier otro activo, asegurando la calidad, seguridad, integridad, disponibilidad, uso efectivo, el cumplimiento de regulaciones internas y externas, y por ende los aspectos éticos derivados del uso de los datos.

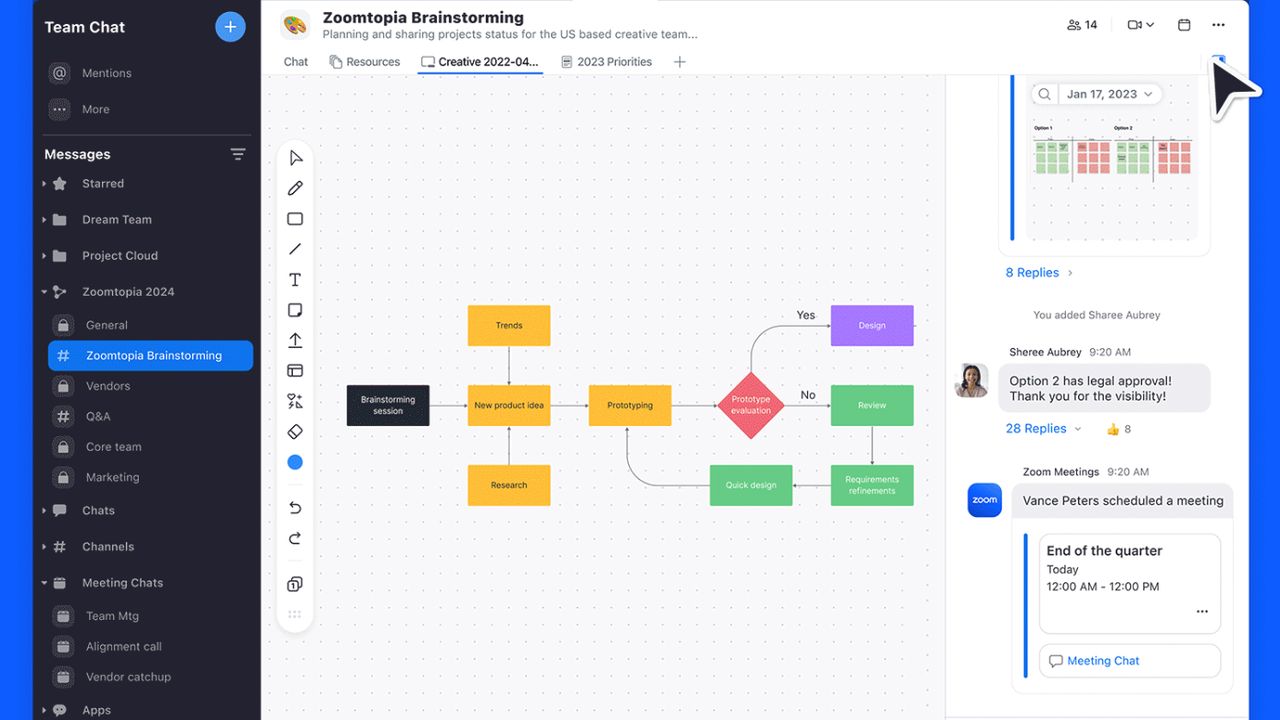

Para alcanzar este objetivo las compañías deben implantar proyectos de gobierno de los datos, un conjunto de políticas y procedimientos que combinados establecen los procesos que supervisan el uso y gestión de los datos para transformarlos en un activo estratégico, con el objetivo de llevar a nuestra compañía a un nivel superior de “madurez en el uso de la información” mejorar la calidad de los datos y solucionar los posibles inconsistencias, gestionar el cambio en relación con el uso de los datos y cumplir con regulaciones y estándares internos y externos.

Las iniciativas de gobierno de los datos tienen como requerimiento especial la supervisión de las decisiones propuestas por los sistemas de explotación de la información (por ejemplo tecnologías de Business Intelligence y de Big Data), y especialmente por los algoritmos de inteligencia artificial.

El autor de este artículo es Óscar Alonso,information strategist, data management & analytics technical manager en Everis y teaching partner & mentor en UOC.